Как опытный водитель электромобиля, ставший свидетелем эволюции технологии беспилотного вождения, я должен признать, что технология полного самоуправления (FSD) Tesla действительно впечатляет — когда она работает. Однако, прочитав последний отчет AMCI Testing, я все больше скептически отношусь к его готовности к широкому внедрению.

Передовая технология беспилотного вождения, разработанная Tesla, известная как Full Self-Driving (FSD), часто рекламируется как революционная инновация в автомобильной промышленности ее генеральным директором Илоном Маском. Однако независимые оценки и данные часто представляют менее оптимистичный взгляд на его возможности. Недавно AMCI Testing, независимая организация по тестированию транспортных средств, провела новую оценку, которая подчеркивает недостатки FSD Tesla, вызывая опасения по поводу ее пригодности для широкого использования в ближайшем будущем.

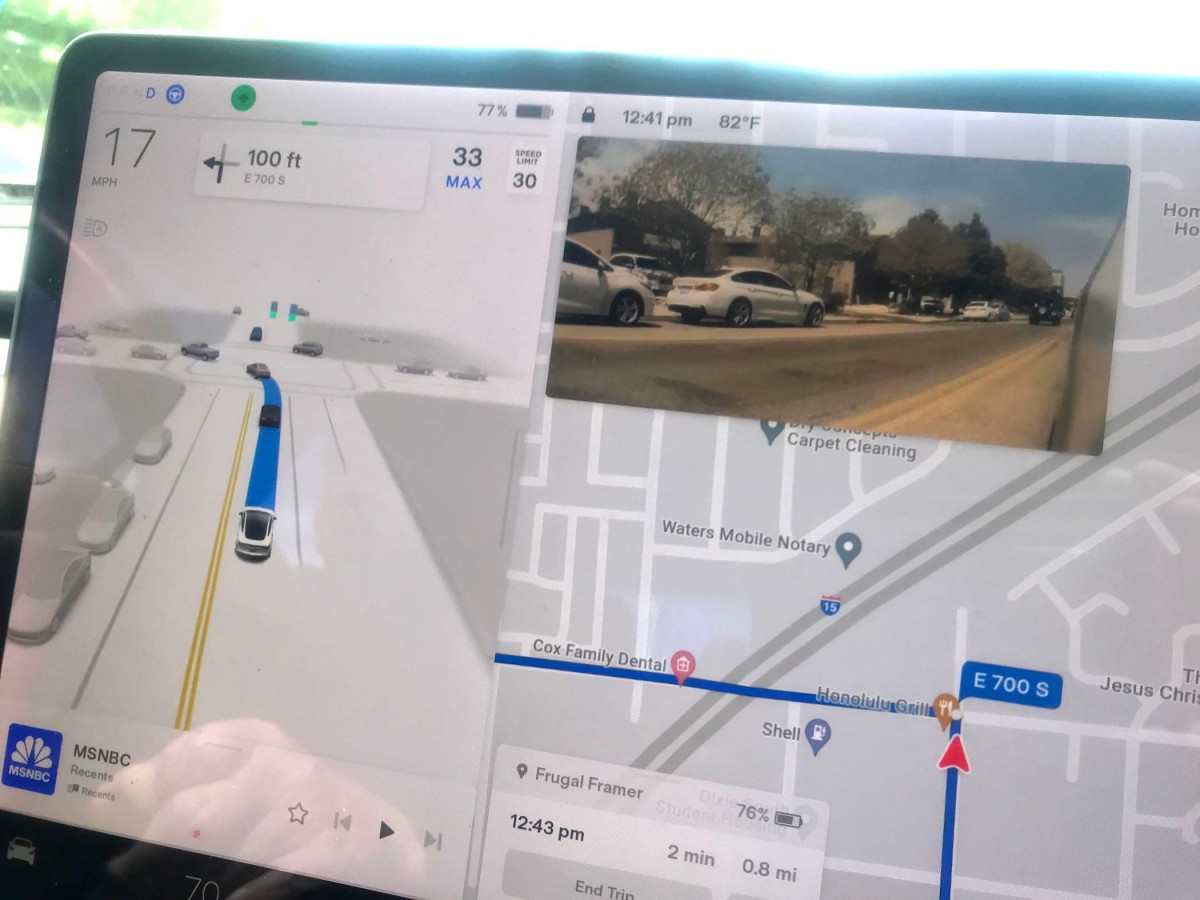

В ходе испытаний, охватывающих 1000 миль с использованием автомобиля Tesla Model 3 Performance 2024 года выпуска, оснащенного оборудованием Hardware 4 и работающего на версиях FSD 12.5.1 и 12.5.3, AMCI обнаружила тревожный факт: водителям приходилось вмешиваться в среднем каждые 13 миль. Это означает, что за период испытаний было более 75 случаев, когда вмешательство человека было необходимо, что значительно превышает ожидания даже самых резких критиков FSD.

Результаты резко контрастируют с данными краудсорсинга, которые свидетельствуют о гораздо более высоком среднем расстоянии между разъединениями. Хотя AMCI признает, что система FSD Tesla впечатляет своей способностью имитировать человеческое поведение вождения, особенно для системы на основе камеры, она также предупреждает об опасности самоуспокоенности.

Проще говоря, Гай Манджамеле, директор по тестированию AMCI, предупреждает, что первоначальная безупречность системы может дать водителям ложное чувство безопасности, заставляя их отпустить руль или отвлечься. Однако он настоятельно не советует этого делать, поскольку даже опытным водителям необходимо быть начеку, чтобы в режиме реального времени распознавать быстрые ошибки, допущенные системой автономного вождения (FSD).

Особенно тревожит то, что сбои в полностью самоуправляемых системах происходят неожиданно. Манджиамеле отмечает, что система может неоднократно обрабатывать определенную ситуацию, но при следующей попытке загадочным образом дает сбой. Пока неясно, вызвано ли это недостаточной вычислительной мощностью, задержками передачи или недостатками восприятия окружающей среды системой.

Тесты, проведенные AMCI, выявили повторяющиеся проблемы, связанные с фундаментальными ошибками в кодировании. Например, система часто начинала переключать полосы движения в сторону выезда на автостраду незадолго до фактического выезда, что ухудшало ее производительность и вызывало подозрения в отношении основного программного обеспечения системы.

Поскольку беспилотные автомобили становятся все более распространенными в автомобильном секторе, система Full Self-Driving (FSD) Tesla служит интригующей, но обсуждаемой иллюстрацией препятствий и сложностей, с которыми приходится сталкиваться при реализации этой амбиции. Поскольку AMCI готовится поделиться дополнительными видеороликами и оценить предстоящие обновления FSD, вполне вероятно, что пристальное изучение этой технологии будет продолжаться, гарантируя, что как Tesla, так и весь автомобильный мир будут оставаться начеку и оперативно реагировать.

Смотрите также

- Уже произведено 10 000 Xiaomi SU7, через 32 дня после начала производства

- Вы не поверите, что предлагает GEELY EX5 за менее чем €27К в 2025 году!

- Познакомьтесь с командой APX GP F1: команда, отмеченная Брэдом Питтом, выйдет на большой экран в 2025 году

- Mercedes-Benz G580 против GMC Hummer EV: суровые электромобили противостоят друг другу

- Помимо роботакси, электромобиль за 25 000 долларов был бы «бессмысленным», говорит генеральный директор Tesla

- Массовый набор персонала Xiaomi: Отвечая на взрывной спрос на электромобили Yu 7

- Lucid Air Гранд Туринг: дальность хода 1000 км и бесшумное салонное пространство!

- NASCAR столкнулся с проблемой в Боумен-Грей, но это хорошая проблема

- Топ-4 автомобиля мощностью 300 лошадиных сил

- Как 10-й сезон Формулы E заложил основу для будущего успеха?

2024-09-27 10:35